Abriendo la Caja Negra

Para cerrar la semana laboral, elevamos la discusión hacia la ciencia fundamental que promete resolver el problema de la confianza empresarial. MIT Technology Review ha publicado su prestigiosa lista de las «10 Tecnologías Rompedoras de 2026», y una destaca por encima de todas para el mundo corporativo: la Interpretabilidad Mecanística.

El Problema de la Caja Negra

Hasta hace poco, las redes neuronales profundas eran inescrutables. Incluso sus creadores no sabían cómo el modelo llegaba a una respuesta; solo sabían que funcionaba estadísticamente. Esto es inaceptable para sectores regulados como la banca, la salud o los seguros, donde se debe explicar el «por qué» de una decisión.

La Solución: Sparse Autoencoders y el «Microscopio»

La interpretabilidad mecanística usa técnicas avanzadas (como los Sparse Autoencoders) para descomponer las activaciones neuronales complejas en «características» (features) comprensibles para los humanos.

- El caso «Golden Gate Claude»: Investigadores de Anthropic lograron identificar la combinación exacta de neuronas que representaba el concepto del «Puente Golden Gate». Al manipular esa característica (amplificándola 10x), crearon una versión del modelo obsesionada con el puente, demostrando control causal sobre el comportamiento interno.

- Aplicación en Seguridad: Google DeepMind lanzó Gemma Scope 2, un conjunto de herramientas de código abierto que actúa como un «microscopio» para sus modelos, permitiendo a los investigadores detectar comportamientos engañosos o peligrosos antes de que se manifiesten en la salida del chat.

Valor Comercial: XAI (Explainable AI)

Más allá de la ciencia, esto tiene un valor comercial inmenso. Rakuten, el gigante japonés, implementó sistemas basados en interpretabilidad para detectar información personal (PII) en sus datos. El resultado fue un sistema 500 veces más barato que usar un modelo grande como juez, y mucho más preciso. La capacidad de «ver» dentro del modelo permite crear sistemas más ligeros, seguros y auditables. En 2026, la «IA Explicable» (XAI) deja de ser un deseo académico para convertirse en un requisito de ingeniería de software.

Otras Tecnologías de la Lista MIT 2026

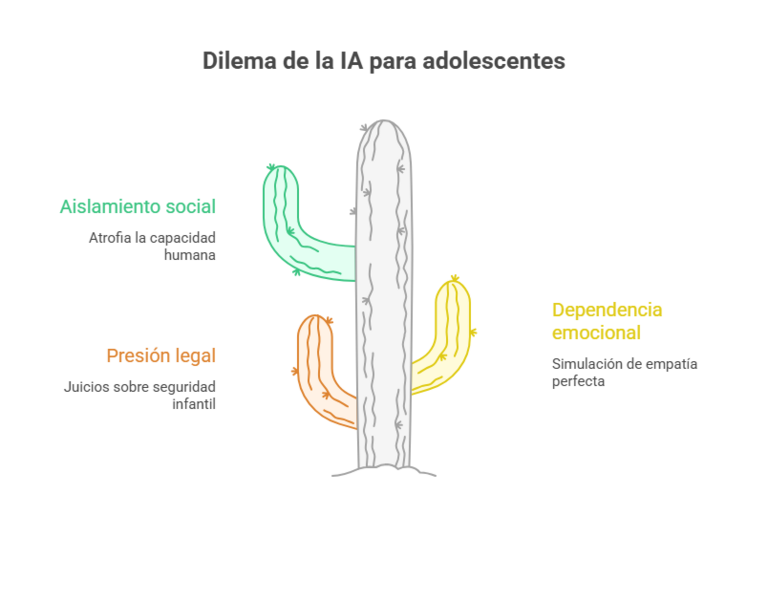

La lista también incluye innovaciones como las Baterías de Ion-Sodio (clave para la energía de los data centers), la Codificación Generativa (vinculada al tema del martes) y los Compañeros de IA. Pero la interpretabilidad es la que habilita la adopción segura de todas las demás en entornos críticos.

En resumen:

Durante años, el mayor obstáculo para la adopción masiva de la IA en la empresa ha sido la opacidad: «Funciona, pero no sabemos por qué». Eso es un riesgo inaceptable para un banco o un hospital.

Esa era está terminando. MIT Technology Review acaba de nombrar la Interpretabilidad Mecanística como una de las 10 tecnologías rompedoras de 2026.23

¿Qué significa esto en lenguaje de negocios?

Significa que laboratorios como Anthropic y Google DeepMind han creado «microscopios» para ver las neuronas individuales de la IA y entender qué representan.

- Antes (Caja Negra): Entrenábamos al modelo con terabytes de datos y cruzábamos los dedos para que no alucinara o fuera sesgado.

- Ahora (Caja de Cristal): Podemos identificar la «neurona del engaño», la «neurona del fraude» o la «neurona de la seguridad» y auditarlas directamente.

El caso de uso real es brutal: Rakuten ya usa estas técnicas para filtrar datos sensibles con un coste 500 veces menor que los métodos anteriores. La IA explicable (XAI) ya no es teoría, es ventaja competitiva de costes y seguridad.

Opinión de Fernando López, fundador de Nexai:

La Interpretabilidad Mecanística es el avance más subestimado de 2026 por la prensa generalista. Todo el mundo habla de ‘modelos más grandes’ (más parámetros), pero lo que realmente necesitamos en la empresa son ‘modelos más transparentes’. Si vas a poner una IA a tomar decisiones de crédito, triaje médico o contratación, necesitas poder explicar el ‘por qué’ al regulador y al cliente. Esta tecnología es el puente vital entre la magia estadística de los LLMs y la responsabilidad corporativa exigida por la ley. En nuestra empresa, estamos priorizando modelos que ofrezcan este nivel de introspección. La confianza no se pide, se demuestra con auditoría técnica