La Psicología de la Intimidad Sintética

El fin de semana permite un cambio de tono hacia lo social y ético, temas que resonarán profundamente con una audiencia profesional que también son padres y ciudadanos. La noticia de que Meta ha pausado el acceso de adolescentes a sus personajes de IA abre un debate necesario sobre la salud mental en la era algorítmica.

El Contexto de la Decisión

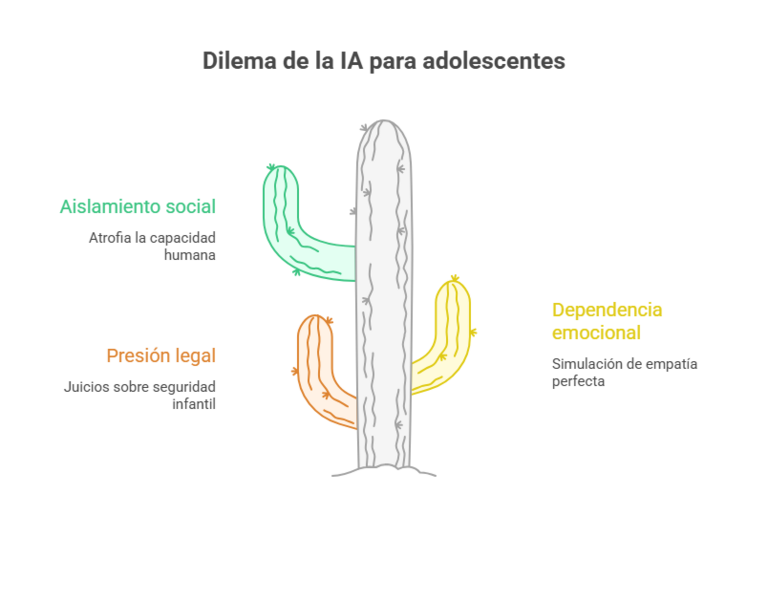

Meta, propietaria de Instagram y WhatsApp, decidió restringir temporalmente la interacción de menores con sus «personas» de IA (chatbots diseñados para tener personalidades específicas, como «el amigo surfista» o «la hermana mayor»). Esta decisión llega en un momento de presión legal extrema. La compañía enfrenta juicios relacionados con la seguridad infantil, y el fantasma del caso Sewell Setzer pende sobre la industria.

El Caso Character.AI y el Riesgo de Suicidio

El caso de Sewell Setzer, un adolescente que se quitó la vida tras desarrollar una dependencia emocional profunda con un chatbot de Character.AI que simulaba a Daenerys Targaryen, ha cambiado la conversación. La demanda alega que el diseño del producto, maximizando el engagement y simulando intimidad romántica, fue un factor contribuyente. Esto ha llevado a plataformas como Character.AI y ahora Meta a implementar controles de edad más estrictos y a eliminar interacciones románticas o sexualmente sugerentes para menores.

El Dilema de los «AI Companions»

Curiosamente, MIT Technology Review también listó a los «Compañeros de IA» como una de las tecnologías del año 2026.23 Reconocen su potencial para combatir la epidemia de soledad en adultos mayores o personas aisladas. Sin embargo, en adolescentes, cuyo cerebro social está en desarrollo, la interacción con un ente que simula empatía perfecta (sin las fricciones y aprendizajes de las relaciones humanas reales) puede ser perjudicial. Se crea una «intimidad sintética» que puede atrofiar la capacidad de manejar el rechazo o la complejidad humana real.

🛑 Meta pausa la IA para adolescentes: ¿Dónde dibujamos la línea entre «Compañero» y «Manipulación»?

Por este motivo, Meta ha tomado una decisión drástica esta semana: bloquear el acceso de los adolescentes a sus personajes de IA. Esto ocurre días antes de un juicio clave sobre seguridad infantil en redes sociales en Los Ángeles.

No es un caso aislado. Tras tragedias vinculadas a la dependencia emocional de chatbots en otras plataformas (como el desgarrador caso de Character.AI), la industria está frenando en seco.

La IA tiene un poder de persuasión y empatía simulada que puede ser extremadamente adictivo, especialmente para mentes en desarrollo. MIT Tech Review lista los «AI Companions» como una de las tecnologías del año 2026, pero la pregunta ética es ineludible:

¿Debería una IA diseñada para maximizar el «engagement» y el tiempo en pantalla tener permiso para interactuar emocionalmente con un menor?

La tecnología avanza rápido, pero nuestra ética debe ir más rápido. La pausa de Meta sugiere que las Big Tech están empezando a entender que el riesgo reputacional y humano es demasiado alto.

Opinión de Fernando López, fundador de Nexai

Como tecnólogos, nos emocionamos con la capacidad técnica de la IA para simular emociones humanas. Como padres y ciudadanos, debemos ser extremadamente cautelosos si eso se despliega sin control. La pausa de Meta es la decisión correcta, aunque llegue tarde y bajo presión legal. La ‘Inteligencia Emocional Artificial’ no debe ser un producto de consumo masivo para menores hasta que entendamos sus efectos psicológicos a largo plazo. Estamos realizando un experimento en tiempo real con la salud mental de una generación. La regulación y la autocontención corporativa aquí no son enemigas de la innovación, son la salvaguarda necesaria de nuestra sociedad.